Fonte immagine: per gentile concessione di Joy Buolamwini

Troppo spesso, le migliori storie di bellezza non vengono raccontate, basandosi esclusivamente sul colore della pelle, la religione, l’espressione di genere, la disabilità o lo stato socioeconomico di una persona. Qui, stiamo passando il microfono ad alcune delle voci più ambiziose e talentuose del settore, in modo che possano condividere, con le loro stesse parole, la straordinaria storia di come sono diventati – e di come stanno usando la bellezza per cambiare il mondo per il meglio. A seguire: Joy Buolamwini, scienziata informatica e fondatrice della Algorithmic Justice League (AJL).

Fin dalla tenera età, ero interessato a cercare modi di usare i computer per aiutare le persone. Crescendo, mio padre, professore di chimica farmaceutica e scienze farmaceutiche, mi portava nel suo laboratorio per nutrire le cellule cancerose. Mi mostrava anche come usava i computer per sviluppare farmaci per combattere il cancro.

Sono cresciuto con un apprezzamento per la ricerca della verità, sia con le arti che con la scienza, grazie a mia madre che è un’artista. All’inizio non ero sicuro se sarei stato in grado di fondere sia la parte artistica di ciò che ho fatto con l’auditing algoritmico, ma ho colto l’occasione per chiedermi, come sarebbe essere un poeta del codice, qualcuno che fonde entrambi i mondi per fare ciò che fanno i poeti, che è illuminare verità scomode o intuizioni nascoste nelle interazioni quotidiane che abbiamo?

Ho sempre avuto anche un po’ di spirito imprenditoriale. Al liceo avevo una piccola azienda di web design e questo mi ha permesso di guadagnare un po’ di soldi in modo da poter pagare l’attrezzatura per il basket, l’atletica e lo sci di fondo, e poi al college ho co-fondato un’azienda tecnologica per la cura dei capelli che avrebbe analizzare il tipo di capelli e dare alle persone consigli personali sui prodotti.

Dopodiché, sono stato davvero fortunato a ottenere una borsa di studio Fulbright per andare in Zambia e ho avviato un’organizzazione che insegnava alle ragazze a programmare. Quando sono arrivato alla scuola di specializzazione, avevo l’esperienza e la fiducia per avviare l’Algorithmic Justice League, un’organizzazione che combina arte, ricerca accademica e advocacy per combattere per le persone danneggiate dall’IA, che mi piace chiamare l'”ex-codificato”.

Ho iniziato a verificare se i sistemi di intelligenza artificiale si comportano in modo diverso a seconda del tipo di viso che viene analizzato e ciò che la mia ricerca ha scoperto è che in effetti lo fanno.

Quando stavo lavorando a un’installazione artistica come studente laureato al MIT, parte dell’installazione doveva tracciare la posizione del mio viso con un software, ma non ha funzionato così bene sul mio viso finché non ho indossato una maschera bianca. Ciò ha portato alla mia ricerca nel 2017 sulla tecnologia facciale e di analisi che potrebbe provare a indovinare il genere di un volto. Quell’esperienza di indossare una maschera bianca per essere resa visibile a una macchina è ciò che mi ha davvero fatto iniziare a chiedere, queste macchine sono così neutre?

Ho iniziato a verificare se i sistemi di intelligenza artificiale si comportano in modo diverso a seconda del tipo di viso che viene analizzato e ciò che la mia ricerca ha scoperto è che in effetti lo fanno. Esaminando i sistemi di intelligenza artificiale di un certo numero di importanti aziende tecnologiche, ho scoperto che i sistemi funzionano meglio sui volti degli uomini rispetto ai volti delle donne quando si tratta di indovinare il genere, e hanno prestazioni migliori sui volti con la pelle più chiara rispetto ai volti con la pelle più scura. Questo mi ha fatto pensare, se quei risultati fossero stati invertiti, questi computer sarebbero stati sul mercato in primo luogo? È stata quell’esperienza di codifica in una maschera bianca, e poi avere l’opportunità di mostrare alcune delle più grandi differenze di precisione nei prodotti di intelligenza artificiale venduti in commercio all’epoca, che mi ha portato a esaminare ulteriormente i problemi del bias codificato, che era davvero il seme per l’avvio della Algorithmic Justice League.

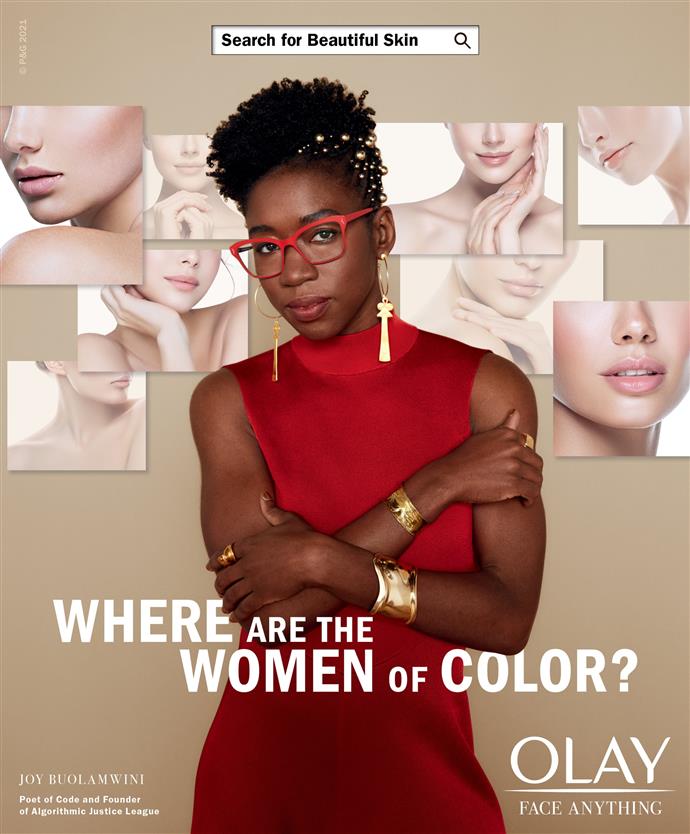

Fonte immagine: per gentile concessione di Olay

Nell’AI di bellezza, se stiamo pensando di analizzare i volti o di far elaborare i volti da una macchina, lo vedrai con i tipi di filtri utilizzati che potrebbero schiarire la pelle o assottigliare il naso come un modo per affermare di migliorare la bellezza — che si basa su standard di bellezza eurocentrici ed emargina le donne di colore. Attraverso la mia ricerca, ho capito di avere questa importante prospettiva da portare dalla mia esperienza vissuta di non essere visto, di essere ex-codificato. È qualcosa che non ha solo un impatto su di me, ma è qualcosa che è nella nostra società più ampia perché abbiamo sistemi di intelligenza artificiale che entrano sempre più in tutte le aree.

Un’altra cosa a cui pensare nello spazio della bellezza è l’uso dell’intelligenza artificiale nel mondo del lavoro: decidere chi viene assunto, chi viene licenziato, chi ottiene una promozione. L’industria della bellezza impiega così tante persone e comprensibilmente le aziende vogliono provare ad adottare le ultime tecnologie, ma dobbiamo davvero pensare ai modi in cui l’IA funge da gatekeeper per chi può anche partecipare all’interno del settore.

Una parte importante di ciò che facciamo con l’Algorithmic Justice League è chiederci come possiamo andare verso un mondo con un’IA più equa e responsabile? Parte di ciò è aumentare la consapevolezza perché non è possibile risolvere un problema di cui non si è nemmeno a conoscenza e molte persone non sono consapevoli del pregiudizio codificato. Questo è il motivo per cui sono stato così felice di collaborare con Olay nella campagna Decode the Bias per combattere i pregiudizi negli algoritmi di bellezza. Pensare a chi sta programmando e come stiamo programmando è una parte essenziale per fare un cambiamento. L’iniziativa del marchio di inviare 1.000 ragazze al campo Black Girls CODE per aiutarle a perseguire carriere STEM aiuta a garantire che le persone che stanno creando le tecnologie che modellano la società riflettano effettivamente la società. I pregiudizi continuano a mostrare cosa succede quando non siamo nella stanza.

Nell’AI di bellezza, se stiamo pensando di analizzare i volti o di far elaborare i volti da una macchina, lo vedrai con i tipi di filtri utilizzati che potrebbero schiarire la pelle o assottigliare il naso come un modo per affermare di migliorare la bellezza .

Quando ho iniziato la mia ricerca, ho sperimentato commenti scoraggianti, ma non ho lasciato che ciò mi impedisse di perseguire qualcosa che sentivo estremamente importante. Essere una donna e avere la pelle scura mi ha dato un’esperienza vissuta che ha portato a ricerche di grande impatto che i colleghi più tradizionali non stavano perseguendo o dando priorità in quel momento. E così, la mia esperienza con la codifica in una maschera bianca è ciò che in realtà ha catapultato questa ricerca.

Quando sei in un campo in cui la tua prospettiva non è centrata, hai davvero bisogno di trovare una comunità di supporto. Ho avuto un sistema di supporto molto forte e ottimi mentori e una base davvero solida, quindi penso che dall’inizio sia stato davvero utile per me. Questo mi ha mostrato l’importanza di avere quel tipo di comunità, specialmente come giovane donna di colore e per ragazze di colore. Incoraggio chiunque abbia idee e voglia entrare in questo spazio ma ha paura di dover affrontare un respingimento per andare avanti comunque. Abbiamo ancora bisogno di te.

Fonte immagine: Olay